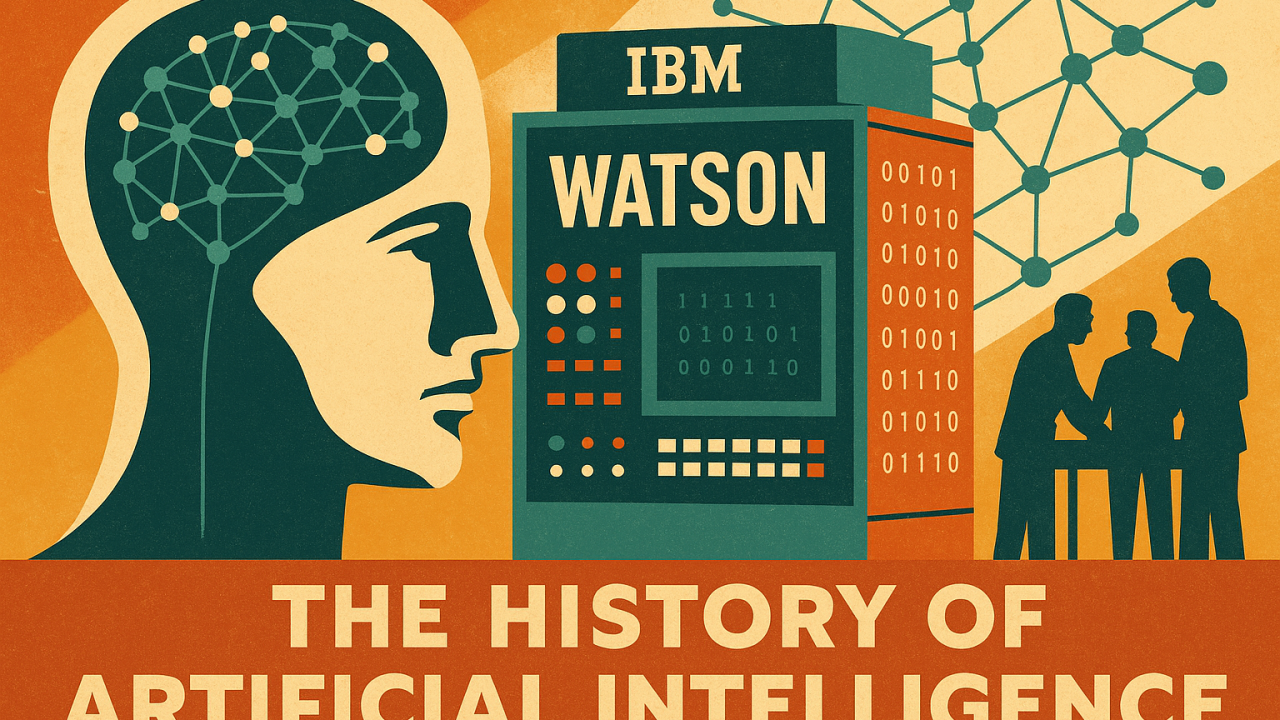

O IBM Watson, a “Mãe” das IAs atuais

Hoje IA (Inteligência Artificial) se tornou algo popular e a cada dia passa a ter milhões de adeptos, mas poucos sabem suas origens e a importância que algumas tecnologias tiveram para chegar no que conhecemos hoje, a proposta desse extenso artigo é nutrir de informação quem deseja se aprofundar e conhecer as origens, pois como no seriado “Smallville”, “Toda história tem um começo”.

Quando se fala sobre inteligência artificial (IA), poucos nomes são tão emblemáticos quanto o de IBM Watson, um sistema que ajudou a moldar a direção das tecnologias cognitivas atuais e se consolidou como um dos marcos iniciais da inteligência artificial moderna. Criado pela IBM, o Watson foi uma das primeiras implementações práticas de IA a demonstrar um vasto potencial, trazendo inovações significativas que hoje são a base para muitas das IAs que usamos no cotidiano.

A história da IA, sim tem uma história, não apareceu do nada no final de 2022!

A história da Inteligência Artificial (IA) não é um conto de avanços repentinos e nem de “prompts” milagrosos que surgiram do nada, mas uma longa e fascinante jornada de ideias, experimentos, triunfos e frustrações que se estende por décadas. Desde os primeiros lampejos teóricos até a impressionante demonstração de capacidade do IBM Watson no início do século XXI, o caminho foi pavimentado por mentes brilhantes e uma persistente busca por replicar a inteligência humana em máquinas.

Embora o desejo de criar seres artificiais inteligentes remonte à mitologia e à ficção, os fundamentos científicos da IA começaram a tomar forma em meados do século XX. O trabalho pioneiro de Alan Turing, um matemático britânico, foi crucial. Em seu artigo de 1950, “Computing Machinery and Intelligence“, Turing propôs o que hoje conhecemos como o “Teste de Turing“, um critério para avaliar se uma máquina pode exibir comportamento inteligente indistinguível do de um ser humano. Ele também explorou a ideia de máquinas que poderiam aprender e pensar quando a mecânica dominava o mundo e a eletrônica ainda estava engatinhando.

Paralelamente, pesquisadores como Warren McCulloch e Walter Pitts (1943) desenvolveram modelos matemáticos de neurônios, sugerindo que o cérebro poderia ser entendido como uma rede de unidades lógicas. Essas ideias foram iniciais para o desenvolvimento das redes neurais artificiais, um dos pilares da IA moderna.

O marco oficial do nascimento da IA como campo de estudo é frequentemente atribuído ao Workshop de Dartmouth, realizado no verão de 1956. Organizado por John McCarthy (que cunhou o termo “Inteligência Artificial”), Marvin Minsky, Nathaniel Rochester e Claude Shannon, o workshop reuniu um grupo de pesquisadores com o objetivo ambicioso de explorar maneiras de fazer as máquinas “usarem a linguagem, formarem abstrações e conceitos, resolverem os tipos de problemas agora reservados aos humanos e se aprimorarem”. A conferência estabeleceu a visão e os objetivos iniciais da IA, gerando um otimismo contagiante.

Impulsionados pelo entusiasmo de Dartmouth e pelo crescente poder computacional, os anos seguintes testemunharam um florescimento da pesquisa em IA. Este período, muitas vezes chamado de “anos dourados”, viu o desenvolvimento de programas que demonstravam capacidades surpreendentes para a época:

- Logic Theorist (1956): Criado por Allen Newell, J.C. Shaw e Herbert Simon, este programa foi capaz de provar teoremas matemáticos do Principia Mathematica de Alfred North Whitehead e Bertrand Russell, alguns de forma até mais elegante que os originais.

- General Problem Solver (GPS): Desenvolvido pela mesma equipe do Logic Theorist, o GPS tentava resolver uma variedade de problemas formais usando uma abordagem de “análise de meios e fins”, imitando o raciocínio humano.

- Programas de Xadrez e Damas: Arthur Samuel, na IBM, desenvolveu um programa de jogo de damas que aprendia com a experiência e conseguia desafiar jogadores humanos habilidosos já no final dos anos 50 e início dos 60.

- SHRDLU (1968-1970): Terry Winograd, no MIT, criou o SHRDLU, um programa de processamento de linguagem natural que operava em um “mundo de blocos”. Ele podia entender e executar comandos em inglês como “pegue o bloco vermelho grande” e responder a perguntas sobre seu ambiente, demonstrando uma notável (embora limitada) compreensão da linguagem.

- ELIZA (1964-1966): Joseph Weizenbaum desenvolveu o ELIZA, um programa que simulava um psicoterapeuta rogeriano, engajando usuários em conversas através da reconfiguração de frases. Embora fosse baseado em truques de correspondência de padrões, muitos usuários atribuíam a ele uma compreensão genuína.

O financiamento para a pesquisa em IA era abundante, vindo principalmente de agências governamentais como a DARPA (Defense Advanced Research Projects Agency) nos Estados Unidos, que viam potencial militar nas tecnologias emergentes. Havia uma crença generalizada de que a inteligência artificial em nível humano estava ao virar da esquina.

No entanto, o otimismo inicial começou a diminuir em meados da década de 1970. O progresso em IA revelou-se muito mais difícil do que o previsto. As limitações dos primeiros sistemas tornaram-se evidentes:

- O Problema da Escalabilidade: Muitas das técnicas que funcionavam bem em problemas simples ou “mundos de brinquedo” (como o mundo de blocos do SHRDLU) falhavam quando aplicadas a problemas do mundo real, que são muito mais complexos e ambíguos.

- A Falta de Conhecimento de Mundo: Os programas não possuíam o vasto conhecimento de senso comum que os humanos usam para entender o mundo e tomar decisões.

- Limitações Computacionais: Apesar dos avanços, o poder computacional ainda era insuficiente para lidar com a complexidade de muitas tarefas de IA.

- Críticas e Relatórios Negativos: O Relatório Lighthill no Reino Unido (1973) e a diminuição do financiamento da DARPA nos EUA refletiram uma crescente desilusão com a falta de resultados práticos significativos.

Este período ficou conhecido como o “primeiro inverno da IA“. O financiamento diminuiu drasticamente, e a pesquisa em IA tornou-se menos proeminente. As promessas exageradas do passado levaram a um ceticismo generalizado.

A IA começou a ressurgir na década de 1980, impulsionada principalmente pelo sucesso dos sistemas especialistas. Estes programas capturavam o conhecimento de especialistas humanos em domínios específicos (como diagnóstico médico, geologia ou configuração de computadores) na forma de regras “se-então”.

- MYCIN (meados da década de 1970): Um dos primeiros sistemas especialistas bem-sucedidos, desenvolvido na Universidade de Stanford, que diagnosticava infecções sanguíneas e recomendava antibióticos com um nível de precisão comparável ao de médicos especialistas.

- XCON (R1) (início da década de 1980): Desenvolvido pela Digital Equipment Corporation (DEC), o XCON ajudava a configurar sistemas de computador complexos, economizando milhões de dólares para a empresa.

O sucesso comercial dos sistemas especialistas reacendeu o interesse e o investimento em IA. Empresas foram fundadas para desenvolver e comercializar essas tecnologias. Paralelamente, houve um ressurgimento do interesse em redes neurais, com o desenvolvimento do algoritmo de retropropagação (backpropagation) por pesquisadores como David Rumelhart, Geoffrey Hinton e Ronald Williams em meados da década de 1980. Isso permitiu que redes neurais com múltiplas camadas fossem treinadas de forma eficaz, abrindo caminho para avanços posteriores em aprendizado de máquina.

No entanto, o entusiasmo em torno dos sistemas especialistas também diminuiu no final da década de 1980 e início da década de 1990, marcando um “segundo inverno da IA”, embora menos severo. A criação e manutenção de sistemas especialistas eram caras e demoradas, e eles eram muitas vezes frágeis quando confrontados com situações fora de seu domínio de especialização.

A década de 1990, embora não marcada por um grande “boom” de IA como as décadas anteriores, foi um período de progresso constante e fundamental, especialmente no campo do aprendizado de máquina (machine learning). Os pesquisadores começaram a se concentrar em abordagens mais estatísticas e probabilísticas, permitindo que os sistemas aprendessem a partir de grandes quantidades de dados.

- Máquinas de Vetores de Suporte (SVMs): Desenvolvidas por Vladimir Vapnik e colegas, tornaram-se uma ferramenta poderosa para classificação e regressão.

- Redes Bayesianas: Forneceram uma estrutura para representar e raciocinar sobre incertezas.

- Algoritmos Genéticos e Computação Evolucionária: Ganharam popularidade para problemas de otimização.

O aumento exponencial do poder computacional e a disponibilidade de grandes conjuntos de dados (impulsionados pela ascensão da internet) foram cruciais para o sucesso dessas novas abordagens. A IA começou a ser incorporada em aplicações mais práticas e muitas vezes invisíveis, como sistemas de recomendação, detecção de fraudes e ferramentas de mineração de dados.

Em 1997, um marco significativo foi a vitória do supercomputador Deep Blue da IBM sobre o campeão mundial de xadrez Garry Kasparov. Embora o Deep Blue dependesse mais da força bruta computacional do que de um raciocínio “humano”, o evento demonstrou o crescente poder das máquinas em tarefas intelectuais complexas.

O início do século XXI viu a continuação dos avanços em aprendizado de máquina e o surgimento de novas arquiteturas, como o aprendizado profundo (deep learning), que viria a revolucionar o campo alguns anos depois. No entanto, um dos eventos mais emblemáticos do poder crescente da IA no início do novo milênio foi o desenvolvimento e o triunfo do IBM Watson.

O Watson foi um projeto ambicioso da IBM, iniciado em 2006, com o objetivo de criar um sistema de computador capaz de responder a perguntas formuladas em linguagem natural humana em um nível de precisão, velocidade e confiança sem precedentes. O desafio escolhido para demonstrar essa capacidade foi o popular programa de televisão americano Jeopardy!, conhecido por suas perguntas complexas que exigem não apenas conhecimento factual, mas também a compreensão de nuances, trocadilhos e metáforas.

A equipe do Watson enfrentou enormes desafios:

- Processamento de Linguagem Natural (PLN): Entender a sintaxe, a semântica e o contexto das pistas do Jeopardy!, que são notoriamente complicadas.

- Recuperação de Informação: Vasculhar e analisar vastas quantidades de dados (enciclopédias, livros, artigos, etc.) para encontrar respostas potenciais.

- Geração de Hipóteses e Avaliação de Confiança: Formular múltiplas respostas candidatas e atribuir um nível de confiança a cada uma delas antes de decidir “apertar o botão”.

- Aprendizado de Máquina: O Watson utilizou algoritmos de aprendizado de máquina para melhorar seu desempenho ao longo do tempo, analisando pistas e respostas anteriores.

Em fevereiro de 2011, o Watson competiu contra dois dos maiores campeões do Jeopardy!, Ken Jennings e Brad Rutter. Em uma partida de três dias amplamente televisionada, o Watson venceu de forma convincente. Este foi um marco porque, ao contrário do Deep Blue, o Watson demonstrou uma capacidade notável de lidar com a ambiguidade e a complexidade da linguagem humana em um jogo que exige muito mais do que simples cálculo.

A vitória do Watson não significou a chegada da “IA geral” (uma IA com a amplitude e profundidade da inteligência humana), mas representou um salto qualitativo na capacidade dos sistemas de IA de processar linguagem natural, analisar informações e tomar decisões complexas em domínios específicos. Abriu caminho para a aplicação de tecnologias semelhantes em áreas como saúde (auxiliando no diagnóstico e na pesquisa), finanças, atendimento ao cliente e muitas outras.

A jornada desde os primeiros conceitos teóricos de Turing e McCulloch até a sofisticada arquitetura do Watson foi longa e repleta de desafios. Cada fase, desde o otimismo inicial, passando pelos “invernos” de desilusão, até os renascimentos impulsionados por novas abordagens e maior poder computacional, contribuiu para o estado atual da Inteligência Artificial. O Watson, no início do século XXI, não foi um ponto final, mas sim um farol brilhante, iluminando o potencial imenso e as futuras direções de um campo que continua a moldar o nosso mundo de maneiras profundas e transformadoras.

É impossível contar a história da Inteligência Artificial (IA) sem dedicar atenção especial ao universo dos video games. Muito antes de o Watson sonhar em desafiar campeões no Jeopardy!, os jogos eletrônicos já eram um campo fértil para a experimentação e, principalmente, para a popularização de conceitos de IA, mesmo que de forma rudimentar no início. Eles não apenas usaram, mas “abusaram” da IA, tornando-a um componente essencial para criar desafios, narrativas e mundos virtuais interativos. Mas isso será tratado em um artigo em breve dedicado a essa fascinante aplicação das IAs: Os vídeo games.

Avanços na IA decorrentes do Watson

Outro grande avanço proporcionado pelo Watson foi o uso de aprendizado de máquina e análise de big data para resolver problemas complexos. O Watson foi capaz de processar grandes volumes de dados estruturados e não estruturados, como textos, imagens e áudios, para identificar padrões e fazer inferências. Esse poder de análise permitiu que ele fosse aplicado em diversos campos, como no diagnóstico médico, onde a IA analisava históricos clínicos, literatura médica e outros dados para fornecer sugestões de diagnósticos e tratamentos. Com isso, o Watson mostrou como a IA poderia transformar a forma como as empresas e setores utilizam dados para tomar decisões.

O Watson também se destacou como um dos primeiros sistemas cognitivos, uma área da IA que tenta replicar a maneira como os seres humanos pensam, aprendem e resolvem problemas. Ao contrário das IAs tradicionais, que se baseiam em algoritmos predefinidos, os sistemas cognitivos, como o Watson, são projetados para aprender com a experiência e adaptar-se a novos contextos. Essa capacidade de adaptação foi um dos maiores avanços da IA, permitindo que o Watson fosse usado em uma ampla gama de indústrias e situações, desde o atendimento ao cliente até a análise de dados complexos em setores como finanças e jurídico.

O impacto do Watson não se limitou à pesquisa e ao desenvolvimento. A IBM teve a visão de tornar o Watson acessível como uma plataforma de IA como serviço (AIaaS), permitindo que empresas de diferentes portes e setores pudessem integrar suas capacidades em suas operações. O Watson foi utilizado em áreas como saúde, onde ajudou médicos a realizar diagnósticos mais rápidos e precisos, e no setor financeiro, onde contribuiu para a análise de grandes volumes de dados e otimização de processos de negócios. O sucesso de Watson em várias indústrias provou que a IA não era mais uma promessa futurística, mas uma realidade aplicável e capaz de transformar o mercado.

A transformação do Watson em uma plataforma de IA como serviço também foi um dos fatores que ajudaram a democratizar o uso da inteligência artificial. Empresas, desenvolvedores e até pequenas startups puderam acessar a plataforma do Watson e utilizar suas funcionalidades para criar soluções inovadoras, sem precisar de grandes investimentos em infraestrutura de IA. Com isso, o Watson impulsionou a popularização da IA, permitindo sua implementação em uma variedade de contextos, desde análise de dados até automação de processos, contribuindo para a criação de um ecossistema mais dinâmico e acessível de inteligência artificial.

O IBM Watson não é apenas uma ferramenta avançada de IA, mas um verdadeiro marco histórico na evolução da inteligência artificial. Ao combinar processamento de linguagem natural, aprendizado de máquina, análise de big data e capacidades cognitivas, o Watson pavimentou o caminho para as tecnologias de IA que conhecemos e utilizamos hoje. Seu legado vai além de seus feitos individuais, como a vitória no Jeopardy! ou sua aplicação na saúde, pois abriu portas para uma nova era da inteligência artificial, mais acessível, adaptável e integrada ao nosso cotidiano. Assim, podemos afirmar que o Watson foi, sem dúvida, uma das mães das IAs modernas, influenciando diretamente o desenvolvimento das tecnologias que continuam a transformar o mundo em que vivemos.

O projeto Watson da IBM, iniciado em 2006, envolveu um investimento significativo, estimado em centenas de milhões de dólares, com foco em pesquisa e desenvolvimento de inteligência artificial e processamento de linguagem natural. A IBM dedicou recursos substanciais à criação de uma infraestrutura de alta performance, incluindo servidores especializados, para suportar o sistema em suas primeiras fases, como na competição histórica de 2011 no Jeopardy!. Esse investimento foi crucial para o avanço da plataforma, que se tornou um dos marcos na computação cognitiva.

Desde o início, mais de 100 pessoas, incluindo cientistas da computação, engenheiros, linguistas computacionais e especialistas em IA, estiveram envolvidas no desenvolvimento do Watson. Com o passar dos anos, a equipe cresceu, incorporando colaborações com instituições acadêmicas e parcerias com diversos setores. O Watson evoluiu para ser aplicado em áreas como saúde, finanças e automação de processos de negócios, com a IBM continuando a investir no aprimoramento e expansão da plataforma, focada agora em soluções empresariais e nichos específicos.

Deixo claro aqui que não tenho nenhuma relação com a IBM e nem com os pesquisadores do Watson, mas achei oportuno citar esse elemento que foi crucial para o que conhecemos sobre IA hoje em dia.

Participação: “Envie suas perguntas e comentários! Adoramos ouvir suas ideias e sugestões sobre como podemos melhorar nossa news!!

francisco.garcia@difini.com.br

Confira a TV Humana, a WebTV dedicada a mostrar o “lado bom da humanidade”. Como fundador, tenho o privilégio de colaborar com um grupo de amigos altamente talentosos e capacitado, criando conteúdo dinâmico focado em educação, entretenimento e cultura. Acesse www.tvhumana.com.br e confira meu programa semanal, “Papo na Cidade“, onde converso com personalidades de diversos segmentos. Venha explorar conosco os aspectos mais positivos da vida!